无标题¶

目录

遥感教程简介-第2部分第5a页

在本引言的前5页中,重点介绍了电磁辐射的性质和特性,电磁辐射是有关遥感感兴趣目标的材料、物体和特征的信息载体。但要收集和处理这些信息,需要一种称为传感器的设备来检测和测量辐射。本页介绍传感器设计和开发中涉及的基本原则。这里介绍的一个分类表明了可用于“完成任务”的各种传感器。电影摄影机系统和雷达的讨论推迟到其他章节。本页主要介绍扫描光谱辐射计,这是一类在这种稳定的远程传感器中的“工作马”。

传感器技术

到目前为止,我们主要从与材料和物体相互作用的来源和行为方面考虑了电磁辐射的性质和特点。据指出,大部分被感测的辐射要么被反射,要么从目标发射,通常通过空气,直到它被传感器监测。传感器由什么组成以及如何执行(操作)的主题非常重要且范围广泛。在本教程中,它也太过复杂,不值得进行扩展处理。然而,本页上有一些基本要素的概要。日本遥感协会(Japanese Association of Remote Sensing)在互联网上对此进行了全面的综述。 mirror site . 传感器及其应用程序的一些有用链接包含在本文中。 NASA site.

大多数遥感仪器(传感器)都是为测量光子而设计的。传感器工作的基本原理集中在关键部件——探测器上。这就是 光电效应 (阿尔伯特·爱因斯坦首先详细解释了这一点,因此获得了诺贝尔奖。 [not for Relativity which was a much greater achievement] 然而,他的发现是量子物理学发展的关键一步)。简单地说,这表明,当一些合适的光敏材料的带负电荷的板受到光子束时,会产生负粒子(电子)的发射。然后,电子就可以从金属板中流出,被收集起来,并作为一个信号进行计数。一个关键点:产生的电流大小(单位时间内的光电子数)与光强度成正比。因此,电流的变化可用于测量在给定时间间隔内撞击板(探测器)的光子(数;强度)的变化。释放的光电子的动能随撞击辐射的频率(或波长)而变化。但是,不同的材料在不同的波长间隔内经历光电效应释放电子;每个材料都有一个现象开始的阈值波长和一个较长的停止的波长。

现在,以这一原理作为大多数远程传感器操作的基础,让我们在这两个图中总结关于传感器类型(分类)的几个主要思想:

第一种是对几种传感器的功能处理,绘制成三角形图,其中角构件由测量的主要参数确定:光谱;空间;强度。

第二类包括更广泛的传感器类型:

从这张强加的清单中,我们将集中讨论光学机械电子辐射计和扫描仪,将摄影机胶片系统和主动雷达的主题留作本教程其他部分的考虑,并将热系统的描述保持在最低限度(见第9节进一步治疗)。顶部组主要包括我们在本节前面讨论过的地球物理传感器。

最广泛的两类传感器是 被动 (导致接收到的辐射的能量来自外部源,如太阳)和 主动的 (传感器系统内部产生的能量向外发射,并测量返回的分数)。传感器可以 non-imaging (测量从感测目标中所有点接收的辐射,将其整合,并将结果报告为电信号强度或其他定量属性,如辐射度)或 成像 (释放的电子用于激发或电离胶片中的银(Ag)等物质,或驱动电视、计算机显示器、阴极射线管、示波器或电子探测器电池等图像生成设备(有关探测器类型的讨论,请参阅本页下文);s由于辐射与目标中的特定点有关,最终结果是图像 [照片] 或栅格显示器[如:电视屏幕上的平行线水平)。

辐射计 是任何仪器的一个通用术语,它可以在电磁频谱的某个区间内定量测量电磁辐射。当辐射是来自包括可见光在内的窄光谱带的光时, 光度计 可以替换。如果传感器包括一个组件,例如棱镜或衍射栅格,它可以将延伸到光谱的一部分的辐射分解成离散的波长,并以不同的角度分散(或分离)到探测器上,则称为 分光计 . 一种分光计(用于化学分析实验室)通过一个狭缝将多波长辐射传递到一种分散介质上,该介质将狭缝以不同间距的线在薄膜板上重现。术语 光谱辐射计 倾向于暗示分散的辐射是在波段而不是离散的波长。大多数空气/空间传感器都是光谱辐射计。

立即测量来自整个现场的辐射的传感器被称为 框架系统 . 眼睛、照相机和电视摄像机属于这个组。框架场景的大小由定义 视野,或视野 . 如果在有限时间内沿着连续线逐点(相当于场景中的小区域)感测场景,则此测量模式构成 扫描系统 . 大多数从移动平台操作的非摄像头传感器通过扫描来对场景进行图像处理。

进一步向下移动分类树,成像传感器的光学设置可以 图像平面 或 光学平面 聚焦(取决于光子光线被透镜会聚的位置),如图所示。

该分类中的另一个属性是传感器是否在 non-scanning 或A 扫描模式 . 这是一对相当复杂的术语,具有多种含义,因为扫描意味着在一个时间间隔内穿过场景的运动,而非扫描是指将传感器固定在感兴趣的场景或目标上,因为它在很短的时间内被感测到。牢牢握在手上的胶片相机是一种非扫描装置,当快门打开然后关闭时,它几乎瞬间捕捉到光线。但是,当相机和/或目标移动时,就像电影相机一样,从某种意义上说,它也在执行扫描。现在,目标可以是静态的(不是移动的),但是传感器会扫过被感测的场景,这可以是扫描的,因为传感器是为其探测器设计的,以便在渐进扫描中系统地移动,即使它们也会穿过目标。这是您可能已经绑在计算机上的扫描仪的情况;这里它的平板平台(放置图片的外壳和玻璃表面)也保持放置;扫描也可以通过将图片或纸质文档放在旋转滚筒上(两个运动:圆形和渐进式)来进行。沿滚筒轴方向移动),扫描照明为固定光束。或者,还有两个相关的例子:一台电视摄像机,它包含一个摄像机,在摄像机中,光线照射到光子敏感的表面,产生的电子被连续地移除(每英寸的线是对电视性能的测量),可以保持固定,也可以旋转来扫过一个场景(它本身就是一个空间系统)。扫描操作)并且可以在继续监控场景时及时扫描。数码相机包含一组X-Y探测器,它们连续不断地释放出光子诱导的电子,转换成电压变化的信号。放电是通过系统地扫描探测器来实现的。那个照相机本身可以保持固定或移动。所有这些的要点(在某种程度上是显而易见的)是 扫描 既可用于整个传感器的移动,也可用于检测系统中的一个或多个组件移动光采集、场景观察装置或光或辐射探测器,逐个读取以产生信号的过程。大多数扫描器的两大类是由术语“光学机械”和“光学电子”定义的,前者包含参与扫描场景的基本机械部件(例如,移动镜),后者是由感知到的辐射移动D。直接通过光学元件进入线性或阵列探测器。

分类中未显示的远程传感器的另一个属性与跟踪某一向前运动轨迹(称为轨道或飞行)的模式有关。 path )收集他们的数据。在这样做的时候,他们被称为监控一个区域的路径到路径的两侧;这被称为 铺条宽度 . 宽度由望远镜的全角视场所包围的那部分场景决定,这部分视场实际上是由一个探测器阵列感知的——通常比整个场景的宽度窄,从这个宽度可以让光线通过外部光圈(通常是望远镜)。主要模式如下图所示:

这个 横道 模式通常使用旋转(旋转)或振动镜(使传感器成为光学机械设备)沿一条横穿地面的线(公里;英里)扫描场景,但也非常窄(米;码),或者更常见的是一系列相邻线。这有时被称为“扫帚模式”,从用小型手持扫帚清扫桌子的角度来看,这是一种扫帚模式。)典型的横轨扫描器的一般方案如下所示。该仪器的基本部件(大部分与沿轨系统共用)是1)一个集光望远镜,用于确定任何时刻的场景尺寸(未显示);2)光路列车内的适当光学装置(例如透镜);3)一面镜子(在飞机扫描仪上,这可能完成y旋转;在航天器扫描器上,通常在小角度上振荡);4)将入射辐射分解成光谱间隔的装置(分光镜;光谱衍射栅格;带滤波器);5)将如此分散的光引导到电池或探测器组上的装置;6)电子学nic是指对每个探测器的光电效应进行采样,然后重置为基本状态,以接收下一个进入的光包,从而产生与来自地面或目标的光值变化相关的信号;以及7)将信号读取为一种模拟(可显示为随时间变化的强度图(曲线),或将信号转换为数字。扫描仪还可以具有 斩波器 它是一个移动的狭缝或开口,当它交替旋转时,允许信号通过检测器或中断信号(无开口区域),通常将其重定向到参考检测器以校准仪器响应。

每一行被细分为一系列单独的空间元素,这些元素代表被成像的场景表面(或者,如果要感测的目标是三维大气)上相应的方形、矩形或圆形区域(地面分辨率单元)。因此,沿着任何一条线都有一个连续的单元阵列,每个单元都会发出辐射。细胞沿着线路一个接一个地被感应到。在传感器中,每个单元都与 象素 (象素)与微电子探测器相连的;每个象素在短时间内由光电效应转换成电子的某个单一辐射值(如反射率)来表征。

像素的区域覆盖范围(即对应的地面单元区域)由 传感器系统的瞬时视场 . ifov定义为从探测器延伸到地面上任何时刻测量的固体角(见上图)。IFOV是传感器光学特性、信号采样率、任何光导纤维(如光纤)尺寸、探测器尺寸以及目标或场景上方高度的函数。电子被一个像素一个像素地依次移除,以形成变化的信号,该信号定义了逐步采样场景中辐射的空间变化。然后根据这些变化生成图像-每个变化都被分配给其像素作为一个称为dn的离散值(一个数字,通过在有限范围内将模拟信号转换为整数的数字值而生成 [for example, the Landsat system range is 28, which spreads from 0 to 255] )使用这些dn值,通过将二维像素阵列(逐像素)和沿着传感器(在飞机或航天器等平台上)的前进方向逐行转换为灰度,在胶片(照片)或监视器(图像)上重新创建场景的“图片”。s的增量由dn范围决定。

这个 沿轨道 模式没有镜子以不同角度观察。相反,有一排小的灵敏探测器并排堆放,每一个探测器的板表面都有一些微小的尺寸;这些可能有几千个。每个探测器都是电荷耦合器件(CCD),如本页下文所述。在这种模式下,最终构成图像的像素对应于线阵列中的各个探测器。当平台沿着轨道前进时,在任何给定时刻,传感器都会同时接收来自地面线路上每个地面单元区域的辐射,并且每个单元的光子集合会以与其地面位置的适当几何关系撞击到每个单独的探测装置上。或者在相当于该位置的线性阵列中。在很短的时间(毫秒)内,信号从每个探测器中连续地从阵列中移除,探测器被重置为零状态,然后暴露在传感器向前运动所达到的地面上下一行的新辐射中。这种类型的扫描也被称为推扫扫描(从用宽扫帚连续向前扫地的精神图像来看)。随着信号采样的提高,一组线性阵列(导致区域阵列)同时采样的可能性将增加地面覆盖的等效面积。

在本页的其余部分,我们将集中讨论扫描光谱辐射计。此表显示了传感器系统的常见组件(并非所有组件都需要存在于给定的传感器中,但大多数都是必需的):

下一个图是一个光电传感器的示意模型,它不包含将入射辐射分解成光谱成分的方法(本质上,这是一个全色系统,其中 滤波器 允许的波长范围很广)。该图包含前两个陆地卫星上的返回光束摄像机(类似电视)中的一些元素。下面是陆地卫星多光谱扫描仪(MSS)的简化剖面图,通过这里所称的 快门轮或支架 ,包含每个通过有限波长范围的滤光片,图像扫描系统的光谱方面被添加,即产生离散的光谱带:

传感器的前端通常是一个伸缩系统(在标签11.6°所示的图像中),用于收集和引导辐射到镜子或透镜上。镜子在有限的角度范围内(每侧2.9°角)来回快速摆动。在这个设置中,场景只在一个摆动上成像,比如说向前,而不是在相反或反向摆动上扫描;或者,在两个摆动上都可以进行活动扫描。一些传感器允许镜子以特定的固定角度指向侧面,以捕捉垂直模式地面轨迹附近的场景(例如斑点)。在推扫扫描器中,一个切碎器可能在这一点附近的光学系统中。它是一种机械装置,用于中断信号,以对其进行调制或同步,或者通常允许在系统观察稳定的已知波长和强度的机载参考辐射源时,短暂阻断入射辐射,以便校准鳍。与目标有关的所有信号。其他镜子或透镜可放置在列车内,以进一步重新定向或聚焦辐射。

辐射——通常可见和/或近短波红外,和/或热辐射——必须被分解成光谱元素,分成宽到窄的波段。波段或通道的波长单位宽度由仪器的 光谱分辨率 (见页首 13-5 )棱镜和衍射栅格是将电磁频谱中选定的部分分解成间隔的一种方法;滤波器是另一种方法。在上述MSS的剖面图中,过滤器位于快门轮上。前两个以特定的角度传播辐射,需要在每个波长相关的角度引导辐射的地方放置探测器。或者。对于滤波器设置,光谱采样辐射沿着光纤传输到专用探测器。吸收滤波器只能通过有限的辐射波长范围,吸收超出此范围的辐射。它们可以是宽的也可以是窄的 带通 过滤器。这是典型带通滤波器的图形:

这些滤波器可以是高带通(选择性地去除较短的波长)或低带通(吸收较长的波长)。 干扰 滤波器的工作原理是反射不需要的波长,并在特定的时间间隔内传输其他波长。一般光学和许多扫描光谱辐射计中使用的一种常见的滤光片是 二色性的 滤光片。这使用光学玻璃基板,在其上沉积(在真空设置中)20至50层(通常为0.001 mm厚)的特殊折射率介电材料(或某些组合中的材料),选择性地传输特定范围或波段的波长。吸收几乎为零。在可见范围内操作时,这些滤色片可以是加色滤色片,也可以是减色滤色片。

下一步是让光谱分离的辐射到适当的探测器上。这可以通过透镜或探测器定位来实现,或者,在MSS和其他传感器的情况下,通过将特定范围内的辐射传输到光纤束,光纤束将聚焦辐射传输到单个探测器阵列。对于MSS,这涉及六条线的6条光纤引线,同时扫描到四个光谱带中的每一个的6个探测器,或总共24个探测器。

在遥感的早期,光电倍增管被用作探测器。现在大多数探测器是由固态半导体金属或合金制成的。半导体的导电性介于金属和绝缘体之间。在某些条件下,例如与光子的相互作用,半导体中的电子被激发,并从充满能量的能级(原子核周围的电子轨道构型)移动到另一个能级,称为导带,在非稀土元素中缺少电子。D状态。流动阻力与入射光子的数量成反比。量子理论最能理解这个过程。不同的材料对不同的波长(实际上,对光子能级)有反应,因此具有光谱选择性。

在可见光范围内,金属硅和PBO是常见的探测器材料。硅光电二极管在这个范围内使用。近红外波段的光导材料包括硫化铅(PBS)和砷铟(INAS)。在中红外波段(3-6微米),InSb(铟-锑)具有响应性。8-14微米范围内最常见的探测器材料是Hg-Cd-Te(汞-镉-碲);在操作时,有必要将探测器冷却到接近零开氏度(使用杜瓦制冷机),以优化电子释放效率。ASE其他探测器材料也在特定条件下使用和执行。下一张图表给出了半导体探测在工作波长范围内变化的一些概念。

其他探测系统,在遥感功能中不太常用的有不同的方式。该列表包括光电发射、光电二极管、光电电压和热(辐射吸收)探测器。现在最重要的是CCD,或电荷耦合探测器,在下一段中解释。这种感应电磁辐射的方法是在20世纪70年代发展起来的,它导致了使用电荷耦合器件(CCD)作为探测器的pushbroom扫描仪。此图有助于更好地理解下一段中对CCD的描述:

CCD是一种非常小的硅芯片,它是感光的。当光子撞击一个CCD时,电子电荷就会产生,其大小与短时间间隔(曝光时间)内的撞击辐射强度成正比。从3000到10000多个探测器元件(CCD)可占用长度小于15 cm的线性空间。每单位长度的元素数量以及光学元件决定了仪器的空间分辨率。使用集成电路,每一个线性阵列都会以很快的顺序采样,产生一个随照射阵列的辐射而变化的电信号。这种变化的信号记录通过一个处理器到一个记录器,最后,被用来驱动一个光电设备来产生黑白图像,类似于MSS或TM信号。仪器对几乎瞬间的信号进行采样后,阵列以电子方式放电足够快,以便能够独立检测下一个传入的辐射。作为探测传感器的线性(一维)阵列随着航天器的轨道运动而前进,产生连续的图像数据线(类似于推扫机的前扫)。利用滤波器选择波长间隔,每个间隔都与一个CCD阵列相关联,我们得到多波段传感。当前的CCD系统的一个缺点是它们限制了电磁频谱的可见和近红外(VNIR)间隔。(CCD也是二维阵列的基础——一系列平行排列的线性CCD延伸到一个区域;这些CCD用于现在流行的数码相机中,并且是最近老式望远镜中常用的传感器探测器。)

一旦扫描仪或CCD信号在探测器现场产生,就需要通过电子处理系统进行传输,该系统的输出信号是用来制作图像的信号,或通过计算机程序进行分析(通常是dn变化)。前置放大可能是第一阶段。机载数字化通常应用于信号和校准中使用的参考辐射源。然后,最终输出通过直接读出(视线)或通过卫星中继系统(如TDRSS(跟踪和中继卫星系统;地球同步通信卫星)发送到地面接收站。另一种选择是在磁带录音机上记录信号,并在卫星可以直接发送到接收站时回放信号(这在许多早期卫星上使用,包括陆地卫星 [ERTS] 由于卫星通信网络的大幅度改进,两者现在几乎都已过时。

传感器性能主题超出本页范围。将提到三个常见的措施:1)S/N(信噪比;噪声可能来自内部电子元件或探测器本身);2)NEΔP和NEΔT,噪声等效功率(用于反射)和3)噪声等效温度(用于热发射),与两个相邻检测器之间影响其相应相邻像素的条件。

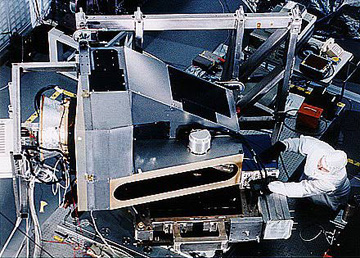

为了将上述理论与真实系统联系起来,我们展示了一张modis传感器的照片,该传感器目前在1999年底发射的Terra航天器和两年后发射的Aqua上运行良好。

最后,我们需要考虑传感器功能和性能的另一个重要方面,即空间分辨率。这一概念在第页进行了回顾。 10-3 关于摄影系统和摄影测量;在这些段落中随时查看该页。在此,我们将尝试对解决方案进行一般性的非技术概述。

我们大多数人对 空间分辨率 . 想想这个经验的例子。假设你正在看一个很远的森林山坡。你所看到的是连续森林的存在,但距离很远,你看不到单独的树木。当你靠近的时候,最终,那些在大小、形状和种类上可能有所不同的树,会变成不同的个体。他们就这样解决了。当你靠近的时候,你开始看到单独的叶子。这意味着一个实体的主要组成部分现在是可识别的,因此这个类别正在被解决。你可以更进一步,通过树叶的宏观结构,然后识别细胞,原则上 更高分辨率 单个组成原子,最后是亚原子成分。最后一步是仪器或传感器所能达到的最高分辨率(与最小尺寸相关)。所有这些级别都代表“识别和分离特定尺寸特征的能力”。如果你从太空中观看场景,你可能无法感觉到树木作为离散特征的存在,因为现在分辨率较低;从很远的距离来看,可能无法检测到一座山或一座山本身的存在-其诊断特征未得到解决。

空间分辨率的一般意义上的定义通常被简单地表述为一个物体的最小尺寸,可以从它周围的物体或特征中挑选出来。这种与邻居或背景的分离可能不足以识别物体。将这些想法与本教程附录D词汇表中提取的三个术语的定义进行比较:

分辨率 -能够在图像或照片上分离密集的物体。分辨率通常表示为单位距离内可区分的最密集的线对。也称为空间分辨率。

分辨率目标 -用于评价图像或照片分辨率的一系列规则间隔的明暗交替条。

分辨力 -单个组件能力的度量。以及遥感系统,分离密集的目标。

这三个术语定义为它们适用于摄影系统(第10-3页再次)。但与分辨率相关的术语也适用于电光系统、标准光学设备,甚至人眼。决议的主题比上述陈述所建议的更为广泛和复杂。让我们更详细地探讨这些想法。第一个基本概念是区分分辨力和分辨力。前者是指 目标 ,即从远处感测到的场景;后者涉及传感器(无论是电子的、胶片的还是眼睛的)分离目标中被感测对象的最小特征的能力。

为了有助于有效(即达到最大)空间分辨率的可视化,让我们使用包含将要列出的对象的目标,并使用人眼作为传感器,使您成为解决过程的一部分,因为这是体验中涉及的最简单的概念。E.(建议:回顾问题I-1答案中对眼睛功能的描述。 [page I-1] 在本节中。)

从一个目标开始,该目标包含红色方块的行和列,每个方块由一条相互接触的细黑线界定。正方形的大小由黑色轮廓决定。在你能看到整个目标的一定距离处,它看起来是均匀的红色。走得越来越近-在某个距离点,你开始看到黑色对比线。因此,你已经开始解决这个目标,因为你现在可以说,有一些特定大小的正方形,这些正方形显示为个体。现在减少黑线间距,使每个正方形(或分辨率单元)变小。你必须靠近一点来解决较小的正方形。或者你必须提高视力(眼睛中的视杆和视锥决定了分辨率;它们的大小决定了眼睛的分辨率;如果一些被损坏了,分辨率就会降低)。

现在修改实验,用一个绿色的版本替换其他的方块,但保持方块的接触。在相当远的距离上,红色和绿色的个体在颜色和形状上都不能被明确区分。它们混合在一起,给眼睛(和大脑处理器)目标的“黄色”印象(颜色组合的效果也在第10节中处理)。但当你接近时,你开始看到这两种颜色的方块作为个体。颜色对开始解析的距离大于上面形成边界的细黑线的情况。因此,对于给定的大小,颜色对比(或色调对比,如黑白或灰色阴影)在确定有效分辨率的开始时变得重要。我们实验的变种是将正方形变为规则排列的圆,并使填充圆之间的空间由非红色背景组成,或者将正方形分开,打开不同的背景。同样,对于一个给定的大小,个体第一次被识别的距离也会随着这些变化的条件而变化。另外一个修改是改变待解决个体的大小和/或形状;这将导致其他距离。现在,我们可以用不同大小、形状、颜色的对象集合中最小的个体来讨论,这些对象可以明显地分离出来,从而得到解决。

三个变量控制实现的空间分辨率:1)刚刚指定的目标特征的性质,最重要的是大小;2)目标和传感装置之间的距离;以及3)术语中体现的传感器的一些固有特性。 分辨力 . 对于最后一个变量,眼睛中的主要因素是视网膜中的视杆和视锥的大小和排列;在照相胶片中,这部分取决于胶片曝光后形成的乳剂中的Agcl颗粒或色斑,尽管在随后的时间里她的相机/胶片系统的特性也进入。

对于本页讨论的传感器类型,有几个变量或因素指定了可获得的最大(最高)分辨率。显然,首先是被感测目标场景特征的空间和光谱特征,包括正在寻找存在和身份的最小对象。接下来,当然是目标和传感器之间的距离。对于飞机或航天器上的传感器,大气的干扰会降低分辨率。平台的速度,无论是气球、飞机、无人驾驶卫星,还是航天飞机或空间站中的人类观察者,都与此相关,因为它决定了传感器探测器在光信号发出的各个特征上可用的“停留时间”。

大多数目标都有某种可感测的限制区域,这是由所用传感器系统的几何配置决定的。这是由上述视场所暗示的,在视场之外,任何时候都没有“可见”的东西。通常,这种视场与望远镜或圆管有关,在那个特定的时刻,望远镜或圆管只接受来自目标的光。望远镜中的光学器件对仪器的分辨力很重要; 放大 是一个因素,因为增加放大能力的透镜系统也提高了分辨率。入射光子的光谱分布也起作用。但是,对于像陆地卫星或点上的传感器(在本简介后面和其他章节中描述),信号采集和探测器组件的机械和/或电子功能成为获得更高分辨率的关键因素。该分辨率也相当于像素大小。(探测器本身通过其固有的信噪比(S/N)能力影响分辨率;这可能随光谱波长而变化)。对于光学机械扫描器,扫描镜运动的振荡或旋转速度和排列将影响瞬时视场ifov),这是三个因素之一,密切控制最终分辨率(像素大小)实现。第二个因素与 尺寸(尺寸) 从反射镜上对应被感测目标段的区域接收光线的光圈。例如,对于陆地卫星MSS,横穿轨道扫描的地面宽度为480m;导纳和聚焦光学系统将宽度分成6条平行扫描线,这些平行扫描线指向6个探测器,这些探测器占80米(更精确的是79m),形成一个像素的一对边。第三个因素控制每个像素的横道边界尺寸,是 采样率 由反射镜(通常通过滤波器)发送到探测器阵列的连续辐射(光)信号束。对于陆地卫星MSS,这要求沿符合ifov(采样元件或像素)的每条扫描线的交叉扫描期间接收的所有辐射,在每10微秒后,通过电子数据在很短的时间内对每个像素进行独立采样,从而在镜子前进后收集一次。探测器充电。对行中的像素序列按顺序进行采样。在10微秒内,镜子的前进相当于在地面上向前扫80米;它的截止形成像素中包含的瞬时信号,从而建立像素的其他两侧(垂直于扫掠方向)。在第一个MSS中,由于取样过程的性质,因此施加的尺寸相当于79×57米。以上段落中的一些观点,目前对你来说仍然是微不足道的,阅读后可能更容易理解。 page 16 详细介绍了陆地卫星多光谱扫描仪。该页解释了79 x 57像素的几何图形。

前面是电子技术中一个复杂的概念,只是在这里被广泛地提到过;足以说明信号必须被细分成离散的包,这些包可以被记录为表面目标在传感器内部的辐射量和光谱性质的单独记录。sed ifov-这些像素可以在dns中数字化,而dns又将成为用于创建图像或以其他方式提供用于分析和解释目标中空间和光谱实体的数据元素(在简单照片中保持P但是,如果由电影摄影机拍摄,则会沿着移动线生成一条连续的图像,传递物体在拍摄的场景中及时移动或随着摄影机沿飞行线移动的位置和时间的连续运动感,如飞行或轨道传感器)。

对于探测器是电荷耦合器件(CCD)的传感器,情况有所不同。相关的分辨率决定因素取决于每个固定探测器的大小,进而决定采样率。这个速率必须与以足够快的速度释放每个探测器的能力“同步”,以产生不间断的光子产生的电子流。这受到传感器运动的限制,因此每个探测器必须以足够快的速度放电(“刷新”),然后记录下一个像素,该像素代表目标的空间相邻部分,然后沿平台运动方向排列。其他分辨率因素适用于热遥感(例如需要将探测器冷却到非常低的温度;见第9节)和雷达(脉冲方向、行程时间、角度扫描等;见第8节)。

由于像素是分辨率的限制,人们可能会问一些比像素所代表的地面尺寸小的物体。这就产生了第页讨论的“混合像素”概念。 13-2 . 分辨率异常是指,在像素地面空间中,小于像素且与其周围环境对比度高的对象的情况下,实际上可能会影响该像素的dn或辐射值,从而使其相对于没有对象的相邻像素变暗或变亮。T(S)和贡献不同的辐射水平。因此,一个像素中的10米宽的深色沥青道路及其由轻土构成的相邻道路将减少该像素的平均辐射,足以产生视觉对比度,从而可以沿着图像中的线性趋势检测道路。

对于显示为摄影图像的感测场景,最佳分辨率是三个动作的组合:1)传感器固有的空间分辨率;2)图像处理过程中施加的明显改进;3)摄影过程中可能存在的进一步改进。举例来说,戈达德地面数据处理系统的一部分,美国国家航空航天局数据处理设施以图片形式生成的陆地卫星MSS图像具有显著的质量;它们在获取最终产品图片时具有一定程度的图像处理能力(后来,这种类型的产品可通过EROS数据中心获取)。但像地球卫星公司(EarthSatelliteCorp.)这样的公司获取了未经处理或校正的陆地卫星数据,并对其进行了更严格的图像处理算法,从而获得了更好的图像。这些可以显著扩大,而不会造成明显的细节损失。然后,通过将dn数据以电子方式生成的图像打印在一种叫做cibachrome的胶片上,从而获得最佳的最终产品,这种胶片最大限度地提高了场景的清晰度并丰富了其颜色,这样观众就可以以最高的质量评价最终结果。

现在,如果您还没有这样做,请转到第页 10-3 回顾了在照片中确定空间分辨率的经典方法,同时也适用于电子生成的图像。

近年来,空间操作传感器的目标是提高空间分辨率(现在,下降到比 [小于] 1米)和更高的光谱分辨率(从大约10-30纳米的带宽(属于陆地卫星MSS)到1纳米或更小),可将能力带入本节和第13节讨论的高光谱模式。

我们还没有定义 辐射分辨率 在这一页。这是一个相当深奥的概念,涉及到量化水平,可以检测或建立,以提高场景质量。所有的传感器都将截获的辐射转换成数字形式,数字形式由一个数值范围内的数字组成。辐射分辨率定义了这个值的范围。具有8位分辨率的传感器(例如Landsat TM)的值范围为256或28。6位传感器(例如Landsat多光谱扫描仪(MSS)1)的范围为64或26个值。欲了解更多信息,请访问本网站 CNES .